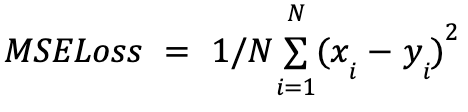

1. 오토인코더 1) 오토 인코더 - 입력데이터를 인코딩 후, 본래의 데이터형태로 디코딩하는 비지도학습 형태의 신경망 (부호화,복호화)- 입력층과 출력층 수가 동일 ( 이외에는 다층 퍼셉트론과 유사 )- 매니폴드를 찾는 것이 핵심 기능 (매니폴드 학습 : 고차원 데이터의 특징과 구조 투사하는 학습과정) (1) 오토인코더 구조 ① 구성 요소 인코더 : 입력데이터를 저차원의 잠재 벡터로 압축 잠재 벡터 ( latency vector ) : 차원 압축의 결과물, z=h(x) 디코더 : 저차원의 잠재벡터를 입력데이터와 유사하게 복원, y=g(z)=g(h(x)) ② 학습 - 손실값 (MSELoss) 최소화 학습 ( 입력데이터 x와 재구성 예측값 y의 오차제곱합을 평균 ) (2) 오토인코더의 특..